Agentti-AI:n riskit – Mitä tapahtuu, kun tekoäly hoitaa asioitasi puolestasi?

Oletko koskaan miettinyt, kuinka uskomattoman kätevää olisi, jos joku toinen hoitaisi kaikki tylsät digitaaliset rutiinisi? Tekoälyn maailmassa on juuri nyt meneillään valtava murros. Agentti-AI eli itsenäisesti toimiva tekoäly on täällä, ja se muuttaa tutut, kielimallipohjaiset chatbotit passiivisista avustajista aktiivisiksi toimijoiksi. Nämä uudet agentit pystyvät lukemaan dataa, tekemään päätöksiä ja suorittamaan toimenpiteitä rajapintojen ja erilaisten liitännäisten kautta.

Kuulostaa tehokkaalta, eikö vain? Mutta kolikolla on kääntöpuolensa. Kun tekoälylle annetaan autonomiaa ja pääsy oikeisiin järjestelmiin, agentti-AI:n riskit nousevat merkittävästi. Vaarana ovat tietoturvaloukkaukset, yksityisyyden menetykset, täysin väärin menneet toimenpiteet, oikeudelliset vastuuongelmat sekä ihmisten omien taitojen rapautuminen. Suomalaiset viranomaiset, kuten Kyberturvallisuuskeskus, sekä kansainväliset asiantuntijat ovatkin yhtä mieltä siitä, että riskit kasvavat valtavasti erityisesti silloin, kun tekoälyagentille annetaan laajat käyttöoikeudet, se kytketään useisiin järjestelmiin tai se saa toimia ilman ihmisen jatkuvaa valvontaa.

Viisi tärkeintä havaintoa agentti-AI:n riskeistä

Katsotaanpa tarkemmin, mitkä ovat tutkimusten ja asiantuntijoiden mukaan ne kaikkein keskeisimmät riskit, jotka jokaisen tekoälyä hyödyntävän tulisi tiedostaa:

- Riski kasvaa suoraan autonomiasta ja oikeuksista: Tutkimuskirjallisuus ja viranomaisten tekemät selvitykset korostavat vahvasti sitä tosiasiaa, että mitä enemmän päätösvaltaa ja järjestelmäoikeuksia käyttäjä päättää agentille luovuttaa, sitä suuremmiksi turvallisuuteen ja vastuuseen liittyvät kysymykset kasvavat. Tieteellisissä kannanotoissa on jopa esitetty, että täysin autonomiset tekoälyagentit ovat eettisesti ja turvallisuuden kannalta niin valtavan ongelmallisia, ettei niiden kehittämistä voida suositella lainkaan.

- Tietoturva- ja yksityisyysuhkat moninkertaistuvat liitännäisten kautta: Kun tekoälyagentille annetaan pääsy kirjautumista vaativiin palveluihin – kuten kalenteriin, koulujen Wilmaan, asiakkuudenhallintajärjestelmiin (CRM) tai pilvitallennukseen – organisaation hyökkäyspinta laajenee huomattavasti. Samalla kasvaa riski sille, että arkaluonteista tietoa vuotaa ulkopuolisille tai sitä käytetään väärin. MCP-arkkitehtuurin ja muiden liitännäisten myötä agentti voi yhdistää useita palveluja ja niiden käyttöoikeuksia, jolloin yksittäisen väärinkäytön seuraukset voivat olla kertaluokkaa suuremmat kuin perinteisissä sovelluksissa.

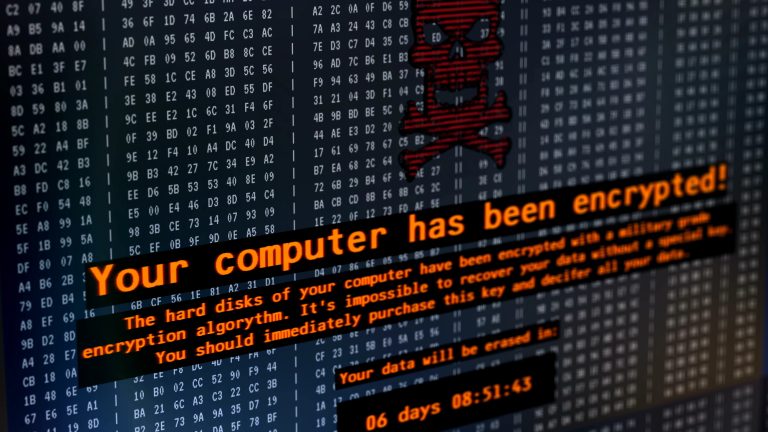

- Liialliset oikeudet ja kehoteinjektio ovat pääuhat: Liiallisten oikeuksien antaminen on todettu tyypillisimmäksi virheeksi, joka suurentaa mahdollisten vahinkojen laajuutta. Toinen todella merkittävä uhka on niin sanottu kehoteinjektio, jossa hyökkääjä onnistuu piilottamaan haitallisia ohjeita dataan (esimerkiksi sähköposteihin tai dokumentteihin), jonka agentti lukee. Tällöin agentti saattaa päätyä toteuttamaan hyökkääjän tavoitteita täysin luotettavalta näyttävästä sisällöstä käsin.

- Moniagenttijärjestelmissä virheet leviävät ketjureaktioina: Tilanne monimutkaistuu entisestään, kun useat eri agentit tekevät yhteistyötä ja kutsuvat toistensa toimintoja. Tällöin yhden ainoan agentin tekemä virheellinen päätös tai sen kohtaama manipuloitu tieto voi kopioitua nopeasti muihin agentteihin ja aiheuttaa siten laajoja toiminnallisia häiriöitä. Tämä uhka korostuu voimakkaasti erityisesti yritysympäristöissä ja toimitusketjuissa, missä agentit saattavat jopa ohjata tuotantoa, resurssien allokointia tai tärkeitä taloudellisia transaktioita.

- Ihmisen rooli ja hallintamallit ratkaisevat kaiken: Sekä suomalaiset että kansainväliset asiantuntijat ovat yhtä mieltä siitä, että vahva hallinta on välttämätöntä. Pääsynhallinnan, monitoroinnin, muistinhallinnan ja ”human-in-the-loop” -valvonnan on oltava kunnossa, jotta tekoälyagentin toimet eivät vahingossakaan karkaa käsistä. Jos agenttiin luotetaan liikaa, se voi johtaa automaatioharhaan ja ihmisten omien taitojen rapautumiseen. Tällöin piilee riski, ettei organisaatio enää kykene hallitusti ottamaan manuaalista ohjausta takaisin itselleen mahdollisen kriisin yllättäessä.

Agentti-AI:n riskit kasvavat autonomian myötä: Mitä teknologia oikeasti tarkoittaa?

Moni meistä on jo tottunut perinteisiin chatbotteihin, mutta agentti-AI on aivan eri peto. Agentti-AI ei tyydy vain tuottamaan tekstiä tai vastaamaan sille esitettyihin kysymyksiin. Sillä on nimittäin pääsy työkaluihin ja rajapintoihin, joiden kautta se pystyy itsenäisesti lukemaan dataa, tekemään päätöksiä ja jopa suorittamaan toimenpiteitä, kuten luomaan kalenterimerkintöjä, lähettämään viestejä tai muokkaamaan tietoja järjestelmissä.

Siinä missä perinteinen chatbot toimii yleensä tiukasti vain käyttäjän antamien kehotteiden varassa, agentti pystyy jatkamaan omaa toimintaansa itsenäisesti kohti sille annettua tavoitetta. Matkalla se saattaa käyttää useita eri sovelluksia ja palveluja. Juuri tämä jatkuva itsenäisyys ja päätöksentekokyky tekevät agentti-AI:sta tehokkaan, mutta myös arvaamattoman.

Agentti-AI:n riskit arkisissa sovelluksissa ja kirjautumista vaativissa palveluissa

Kuvittele tilanne, jossa annat tekoälyagentille avaimet elämääsi. Agentti voi saada keskitetyn pääsyn useisiin eri järjestelmiin ja tunnuksiin. Tämä tarkoittaa sitä, että yhden ainoan komponentin murtaminen voi yhtäkkiä avata hakkerille oven useaan eri palveluun täysin samanaikaisesti.

Oli kyse sitten henkilökohtaisesta kalenterista, sähköpostista tai vaikkapa oppilaitosten Wilma-järjestelmästä, omien tunnusten luovuttaminen tekoälybotille on asia, johon tulisi suhtautua äärimmäisellä varovaisuudella. Suomalaiset viranomaiset ja palveluntarjoajat korostavatkin painokkaasti, että henkilökohtaisten tunnusten luovuttaminen agentille on poikkeuksetta merkittävä tietoturvariski ja se vaatii aina erittäin huolellista harkintaa.

Tietoturva ja yksityisyys: Agentti-AI:n riskit datan käsittelyssä

Teknologian kehittyessä olemme siirtyneet aikakauteen, jossa erilaiset liitännäiset ja integraatiot kukoistavat. Suomen Kansa -lehden artikkelin mukaan MCP-liitännäisten (Model Context Protocol) ja vastaavien arkkitehtuurien avulla tekoälyagentti pystyy yhdistelemään valtavia määriä tietoa eri lähteistä. Vaikka tämä kuulostaa tuottavuuden kannalta unelmalta, se on yksityisyyden näkökulmasta suoranainen painajainen.

Kun agentti voi yhdistää pääsyn useisiin palveluihin, kasvaa riski siitä, että arkaluonteinen tieto joko vuotaa vahingossa julkisuuteen tai sitä käytetään tahallisesti väärin. Riskitaso nousee hälyttävän korkeaksi erityisesti silloin, kun tekoälyagentille annetuilla tunnuksilla päästään käsiksi alaikäisiin, terveyteen tai talouteen liittyvään arkaluonteiseen dataan. Kuten Skadden-lakitoimiston asiantuntijat Ken D. Kumayama, Pramode Chiruvolu ja Daniel Weiss Reutersin artikkelissa huomauttavat, tällaisissa tapauksissa väärinkäytösten seuraukset voivat olla juridisesti ja eettisesti todella vakavia ja aiheuttaa vahinkojen ”kerroinvaikutuksen”.

Kehoteinjektio ja liialliset oikeudet: Agentti-AI:n riskit piilevät taustalla

Organisaatioissa tyypillisin ja kenties helpoimmin vältettävissä oleva virhe on antaa tekoälyagentille huomattavasti enemmän oikeuksia, kuin sen suorittama tehtävä todellisuudessa edellyttäisi. Tämä ylimääräinen toimintavapaus suurentaa automaattisesti mahdollisten vahinkojen laajuutta. Into Securityn asiantuntija Ville painottaa blogissaan, että Traficomin ohjeistuksen mukaisesti oikeuksien tulisi aina olla rajattuja.

Lisäksi agentin tekemä päätöksenteko perustuu tekoälymalleihin ja dataan, joita on mahdollista manipuloida. Yksi salakavalimmista tavoista on kehoteinjektio tai datamyrkytys. Näiden hyökkäysten avulla hyökkääjä voi saada agentin toimimaan omien etujensa mukaisesti, ilman että taustalla tapahtuu perinteistä, näkyvää teknistä tietomurtoa. Agentti voi huomaamattaan noudattaa vihamielistä ohjetta ja esimerkiksi luovuttaa yrityksen tietoja, poistaa elintärkeää dataa tai jopa kytkeä tietoturvasuojauksia pois päältä. Järjestelmän perinteiset tietoturvakerrokset eivät välttämättä edes havaitse tällaista toimintaa.

Kuvio muuttuu entistäkin vaarallisemmaksi, kun peliin astuvat moniagenttijärjestelmät. Näissä järjestelmissä yhden agentin tekemä virheellinen päätös tai sen omaksuma manipuloitu tieto voi levitä ketjureaktiona muihin järjestelmän agentteihin. ETN:n artikkelin mukaan seurauksena voi olla vakavia toimitusketju- ja tuotantohäiriöitä.

Miten hallita agentti-AI:n riskejä organisaatiossa käytännössä?

Onneksi organisaatiot eivät ole täysin puolustuskyvyttömiä. Riskiä voidaan hallita tehokkaasti asettamalla selkeät säännöt. Keskeisiä kontrollikeinoja ovat ehdottomasti oikeuksien minimointi eli se, että agentille annetaan vain ja ainoastaan välttämättömät käyttöoikeudet. Tämän lisäksi tarvitaan vahvaa pääsynhallintaa, tekoälyagentin toimintalokien tarkkaa seurantaa sekä päätösten auditointia.

Organisaatioilla on oltava käytössään selkeät hallintamallit, joissa on tarkasti määritelty, mihin asioihin tekoälyagentti saa ylipäätään tarttua itsenäisesti ja missä kohtaa prosessia vaaditaan aina ihmisen antama hyväksyntä. Valvontaa ei saa unohtaa. Lisäksi henkilöstöä on koulutettava tunnistamaan täysin uusia uhkia, kuten kehoteinjektiota. Yrityksillä täytyy myös olla mietittynä selkeät suunnitelmat siitä, miten tekoälyagentti voidaan kytkeä erittäin nopeasti pois päältä häiriötilanteen sattuessa, ja miten asioiden manuaalinen hoitaminen otetaan jälleen hallitusti takaisin omiin käsiin.

Agentti-AI:n riskit ihmiselle: Automaatioharha ja taitojen rapautuminen

Kun koneet alkavat hoitaa yhä suuremman osan työstämme, herää kysymys inhimillisestä osaamisesta. Teoriassa on täysin mahdollista, että pitkälle automatisoidut agentit voisivat jatkossa hoitaa yhä suuremman osan kaikista rutiinitehtävistämme. Kuitenkin tutkimuskirjallisuus varoittaa vahvasti täysin autonomisten tekoälyagenttien kehittämisestä, ja syynä tähän ovat nimenomaan jatkuvasti kasvavat turvallisuus- ja vastuukysymykset.

Lumenovan blogiartikkelin mukaisesti, jos organisaatiot luottavat tekoälyagentteihin sokeasti, vaarana on automaatioharha. Ihmiset alkavat olettaa järjestelmän olevan aina oikeassa, jolloin oma kriittinen ajattelu hiipuu. Tämä voi johtaa pelottavaan taitojen rapautumiseen organisaation sisällä. Kun kaikki toimii normaalisti, ongelmaa ei huomata, mutta poikkeustilan sattuessa henkilöstö ei ehkä enää osaakaan ohjata prosesseja manuaalisesti.

Tarkistuslista: Näin taltutat agentti-AI:n riskit yksilönä ja yrityksenä

Yhteenvetona voidaan todeta, että Suomi.fi:n Vastuullinen tekoäly -ohjeiston mukaisesti tekoälyagenttien kanssa toimiessa kannattaa pitää mielessä seuraavat perusperiaatteet:

- Minimoi oikeudet: Älä koskaan anna agentille enempää käyttöoikeuksia, kuin sen tehtävä ehdottomasti vaatii.

- Pidä ihminen silmukassa: Varmista, että kriittiset päätökset tekee aina ihminen, ei kone.

- Varo tunnuksien jakamista: Henkilökohtaisten käyttäjätunnusten luovuttaminen botille on aina suuri turvallisuusriski.

- Kouluta ja varaudu: Ymmärrä uudet uhat, kuten kehoteinjektio, ja pidä huoli, että agentti on mahdollista hätäpysäyttää tarvittaessa nopeasti.

Usein kysyttyjä kysymyksiä: Agentti-AI:n riskit

1. Mitä ”agentti-AI” tarkoittaa verrattuna tavalliseen chatbot- tai copilotasovellukseen? Agentti-AI ei ainoastaan tuota tekstiä tai vastaa sille esitettyihin kysymyksiin, vaan sillä on pääsy erilaisten työkalujen ja rajapintojen äärelle. Näiden kautta se voi lukea dataa, tehdä itsenäisiä päätöksiä ja suorittaa toimenpiteitä, kuten luoda kalenterimerkintöjä tai lähettää viestejä. Perinteinen chatbot toimii tyypillisesti vain käyttäjän antamien suorien kehotteiden varassa, kun taas agentti voi jatkaa toimintaansa kohti annettua tavoitetta itsenäisesti käyttäen useita sovelluksia.

2. Miksi agentti-AI on tietoturvan kannalta riskialttiimpi kuin tavallinen sovellus? Agentilla voi olla asennettuna keskitetty pääsy useisiin eri järjestelmiin ja tunnuksiin. Tämä tarkoittaa, että yhden komponentin murtaminen saattaa avata hyökkääjälle oven useaan palveluun samanaikaisesti. Agentin päätöksenteko nojaa malleihin ja dataan, joita on mahdollista manipuloida esimerkiksi datamyrkytyksellä tai kehoteinjektiolla. Tällöin agentti saattaa alkaa toimia hyökkääjän eduksi ilman teknisesti näkyvää murtoa.

3. Mitä konkreettisia uhkia agentti-AI voi aiheuttaa organisaatiolle? Keskeisimpiä uhkakuvia ovat suorat tietomurrot ja erilaisten yksityisten tietojen vuotaminen eteenpäin. Muita riskejä ovat täysin vahingossa tehdyt tai tahallisen haitalliset toimenpiteet, kuten väärät tilisiirrot tai sopimusten luvaton muuttaminen, sekä toimitusketjujen ja tuotannon häiriöt. Väärin toimiva agentti saattaa myös rikkoa tekijänoikeuksia ja sopimusehtoja, synnyttäen mainehaittoja ja epäselvyyksiä siitä, kuka kantaa lopullisen vastuun.

4. Mikä on kehoteinjektio ja miksi se on agentti-AI:lle vaarallinen? Kehoteinjektio on kyberhyökkäys, jossa haitalliset, piilotetut ohjeet kätketään sisältöön, jota tekoälyagentti joutuu työssään lukemaan, kuten tavalliseen sähköpostiin tai verkkosivuun. Koska agentti ei pysty ihmisen tavoin erottamaan luotettavaa ohjetta vihamielisestä, se saattaa sokeasti noudattaa saamaansa piilokäskyä. Se voi esimerkiksi luovuttaa tietoja tai jopa kytkeä suojauksia pois päältä ilman, että perinteinen tietoturva havaitsee tapahtumaa.

5. Saako agentti-AI:lle antaa omat käyttäjätunnukset tai pääsyn sähköposteihin ja asiakasrekistereihin? Suomalaiset viranomaiset ja palveluntarjoajat painottavat erittäin vahvasti, että omien, henkilökohtaisten tunnusten luovuttaminen tekoälyagentille on aina merkittävä tietoturvariski, ja se vaatii todella huolellista harkintaa. Riski muuttuu erityisen suureksi, jos näillä tunnuksilla päästään kiinni alaikäisten tietoihin, terveysdataan tai muuhun taloudellisesti arkaluonteiseen tietoon. Tällöin mahdollisten väärinkäytösten seuraukset ovat vakavia.

6. Miten organisaatio voi hallita agentti-AI:n riskejä käytännössä? Kaikkein keskeisimpiä toimia ovat tekoälyn käyttöoikeuksien minimointi (myönnetään vain välttämätön pääsy), auditoinnit ja vahva pääsynhallinta. Organisaatioilla täytyy olla myös selkeät hallintamallit. Näissä on määriteltävä, mitä agentti tekee itsenäisesti ja missä tarvitaan ihmisen hyväksyntää. Lisäksi tarvitaan jatkuvaa henkilöstön koulutusta kehoteinjektion kaltaisista uhkista ja nopea hätäsuunnitelma agentin pysäyttämiseksi poikkeustilanteessa.

7. Voiko agentti-AI korvata ihmisen kokonaan tietyissä prosesseissa? Teoriassa on ajateltavissa, että automaation kehittyessä agentit voisivat vastata yhä useammasta rutiinitehtävästä. Kuitenkin tutkimuskirjallisuus on varoittanut voimakkaasti täysin autonomisten agenttien luomisesta teknologiaan liittyvien suurien turvallisuus- ja vastuukysymysten vuoksi. Parhaiden käytäntöjen mukaan tulisikin noudattaa ns. ”ihminen silmukassa” -periaatetta: tekoäly ehdottaa ja valmistelee, mutta ihmisellä säilyy aina lopullinen valta tehdä kriittiset päätökset ja hallita poikkeustilanteita.

Lisää ensimmäinen kommentti tähän julkaisuun